发布日期:2023-09-06 11:53:07

无人巡逻物流平台系统

1.1. 工况定义

1.能够实现自主驾驶:可在先验地图内可根据指定的路线进行自主加速、减速、转向、避障、绕障;

2.能够实现无人化巡逻及报警:无人平台根据指令在规定的时间内,按照指定的路线进行巡逻。巡逻期间若通过视觉系统和语音识别系统对出现的目标(人、物、车辆等)进行识别,发现可疑目标则立即向调度中心进行报警,同时向可疑目标进行喊话警告,开启录音录像功能进行取证;若可疑目标在报警期间移动,则进行跟随,直到有工作人员解除报警状态;

3.自主充电功能:完成一次巡逻后(无人平台自主遍历指定路径)回到指定地点进行充电,直到下一个规定巡逻时间。无人平台充电期间依旧保持警戒状态,即视觉系统即语音识别系统持续工作;

4.物流功能:无人平台可根据指令自主驾驶至指定地点接收货品,并按照指定路线运输到指定地点,进行交接。无人平台运输仓具有安全锁,仅在无人平台达到指定地点且完成驻车后,可由指定人员或调度中心控制人员可进行解锁;

5.多种操作途径:无人平台可由调度中心、遥控器及语音进行操控,指令优先级为遥控器>调度中心>语音;

6.无人平台与调度中心以及中继节点通过自组网电台形成内部网络,保障系统信息封闭性及安全性。

1.1.1. 路况设定

本项目适用路况条件是:

1) 具有封闭化、结构化特点的大面积平整绿地。有直行、转弯、岔路、水泥路、沥青路等多种路面;

2) 本项目需在场地预制高精度地图;

2)路面上可以有本系统其它巡逻车作业和正常行驶;

4)自动驾驶最高车速设定30km/h,作业速度5~10km/h;

1.1.2. 天气情况设定

本项目适用的天气条件是:

1)白天和夜间均可(夜间能见度不小于50米),晴天,多云及阴天均可;

2)风力:0~4级(风速0~7.9m/s,即无风~小树枝摇动)避免杂草飞扬;

3)雨天:可满足小雨条件,小雨(1d(或24h)降雨量小于10mm);

4)雾霾:可满足轻雾条件,轻雾,能见度100米;

其他气象条件(如中雨、大雨、下雪、中度及以上雾霾,大风等)暂不考虑。

1.1.3. 适配车型说明

车辆具备线控车辆底盘及物流仓,进行改装和无人驾驶技术实现。

1.1.1. 自主驾驶

1).自检

停靠地点是在停车场地。

整机能源补给形式,充电(精确停到指定充电区域,由充电器无线充电),各控制器上电;车辆自检,底盘平台各系统、作业警示灯光、功能状态等检测,做好作业准备。

2).启航

从停靠点自主运转至作业点,完全自主运行,自行避障,完成巡逻和物流配送。

3).运行作业

(1)可以实现自主巡逻:根据指定的路线进行自主加速、减速、转向、避障、绕障;

(2)根据植入地图和作业路径规划,可进行单机巡逻:在规定的时间内,按照指定的路线进行巡逻。巡逻期间若通过视觉系统和语音识别系统对出现的目标(人、物、车辆等)进行识别,发现可疑目标则立即向调度中心进行报警,同时向可疑目标进行喊话警告,开启录音录像功能进行取证;若可疑目标在报警期间移动,则进行跟随,直到有工作人员解除报警状态;

(3)车辆能源状态,自动回停靠点无线充电补充能源:完成一次巡逻后(无人平台自主遍历指定路径)回到指定地点进行充电,直到下一个规定巡逻时间。无人平台充电期间依旧保持警戒状态,即视觉系统即语音识别系统持续工作;

(4)物流功能:无人平台可根据指令自主驾驶至指定地点接收货品,并按照指定路线运输到指定地点,进行交接。无人平台运输仓具有安全锁,仅在无人平台达到指定地点且完成驻车后,可由指定人员或调度中心控制人员可进行解锁;

(5)无人平台可由调度中心、遥控器及语音进行操控,指令优先级为遥控器>调度中心>语音。

(6)通信组网:无人平台与调度中心以及中继节点通过自组网电台形成内部网络,保障系统信息封闭性及安全性,车辆与控制中心的通讯,车间通讯,车辆位置、状态和作业状态。

4).返航

从作业点自主运转至停靠点,作业状态收回,自主去人完全收回正常后,自主回场,自行避障,运转到停靠点后,自行补充能源(加油人工进行)。

1.1.2. 作业模式

在执行预定的作业任务时,自动驾驶过程中,当出现传感器或车辆故障,可自动判定当前为故障状态,停止作业,并反馈到监控中心请求人工接管。并切换至遥控模式,巡逻车即可按照目前所在位置等待接管或自主返航。

1.1.3. 安全性要求

在上述三种模式下,巡逻车需满足安全性要求,具体如下:

巡逻车具备突发情况应急处理能力,对于信号丢失,相关硬件失灵以及路线前方突然出现的障碍物(前方目标突然刹停、人或物突然出现车前方,两目标突然违规并入前方等突发情况),则采取紧急制动的方式,避免碰撞事故发生。

巡逻车自动行驶及作业过程中无需人工接管,做到安全可靠。

1.1.4. 舒适性要求

巡逻车在自动驾驶过程中运行稳定,在启动、加速、刹车以及收割、转弯等情况下,能够保证平稳运行,不出现急起急停等现象。

1.1. 总体方案

1.1.1. 车辆自动驾驶硬件系统

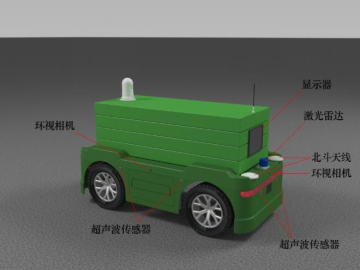

在前期研制的具备线控能力的巡逻车的基础上,通过集成传感器、控制器、定位设备和通信设备,写入相应的软件模块,实现对巡逻车的自动驾驶控制,如图1所示。

图1 自动驾驶系统传感器示意图

在上图中,感知设备主要包括2个激光雷达和8个超声波传感器;定位设备主要由组合惯导来完成,结合激光雷达可以实现更准确可靠的定位;自动驾驶计算平台由智能域控制器组成;为保证安全管控,同时集成了360环视监控设备。

相关指标:

1.无人底盘总质量:≤900kg;

2.无人底盘承载能力:≥300kg;

3.无人平台尺寸:长×宽×高:≥2.6m×1.4m×1.6m;

4.物流仓有效载货空间:长×宽:≥1.5m×1.2m;

5.最da行驶速度:30km/h;

6.续航时间:≥6h;

7.续航里程:≥120km;

8.具有无线充电功能;

9.无线电充电功率:≥2kW;

10.最da爬坡能力:≥10°;

11.越障高:≥5cm;

12.越壕宽:≥10cm;

13.寻迹精度:20km/h直线寻迹精度:±30cm;5km/h弯道寻迹精度:±50cm;

14.感知半径:≥10m;

15.最xiao可感知障碍物:20cm×20cm×20cm(前后10m感知范围内);

16.跟车行驶最da速度:30km/h;

17.决策时间:≤500ms;

18.响应延迟:≤1s;

19.高清相机:可拍摄720P视频;

20.转台:旋转周期≤3s。

(1)计算平台

计算平台主要用到控制器,控制器采用车规级芯片设计,采用8核SOC处理处理器和MCU芯片协同计算,大幅提高数据的处理效率。充分发挥异构计算的优势,双小核结构,对整数、浮点、内存等作了大幅优化,可以处理一些复杂算法,能作为自动驾驶系统的感知、控制和决策等功能模块的计算平台。控制器集成了4G模块和音频模块,可以根据要求访问外网服务器并且可以根据系统需求播报语音。

控制器运行内存2GB,支持最da扩展存储空间32GB,搭载了Ubuntu16.04系统。系统可部署自动驾驶相关工具软件,例如LCM(Lightweight Commuciation and Marshalling) 是作为消息传递和封装的通信库,可以简化低时延消息传递系统的开发;ROS(Robot Operating System)机器人操作系统,是一种具有高度灵活性的软件架构。

同时可以通过集成的switch芯片扩展外部网络接口,可以连接外部的通信和显控设备,能通过SSH或telnet远程登录系统,或者通过DHCP自动获取允许IP、Bateway、DNS,进而可以通过4G访问外网,访问核心处理器并进行软件和程序部署及维护。

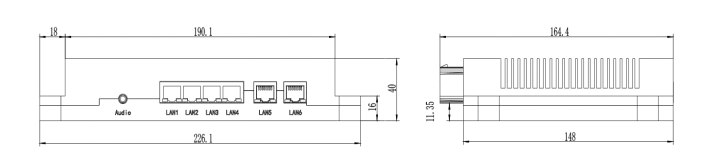

控制器机械尺寸如图2所示。

图2 控制器机械尺寸

控制器相关指标参数如表1所示。

表1控制器相关参数

指标 | 参数 | 指标 | 参数 |

外壳尺寸 | 221*164*40mm | 运行空间 | 2GB |

重量 | 1KG | 计算能力 | 2T |

机械结构 | 铝合金 | 存储空间 | 8GB |

喷涂工艺 | 阳极氧化发黑 | 工作电压 | 8-16V DC |

控制器设计有8组CAN接口,4组232串口(其中一组可配置为485接口),1组422接口,5个千兆以太网口,1个百兆以太网口,音频接口,4G和WIFI天线接口,具体描述如表2所示。

表2 控制器外部接口型号及数量

序号 | 连接器名称 | 接口类型 | 接口数量 | 丝印名称 |

1 | 35P车规连接器 | 422接口 | 1 | 776136 |

CAN接口 | 4 | |||

232接口 | 1 | |||

485/422接口 | 1 | |||

2 | RJ45 1*4 (HY911431A) | 千兆以太网接口 | 3 | LAN2 LAN3 LAN4 |

百兆以太网接口 | 1 | LAN1 | ||

3 | RJ45 (HY911130) | 千兆以太网接口 | 1 | LAN5 LAN6 |

4 | SMA射频接口 (外螺纹内针) | 4G天线 | 2 | 4G |

WIFI天线 | 1 | WIFI | ||

5 | 3.5MM耳机接口 | 音频接口 | 1 | Audio |

(2)传感器

1)激光雷达

为保证充分感知车辆周围目标,因此在车辆的前部两侧安装两个16线激光雷达,在车辆后方安装1个16线激光雷达,实现对车辆周围目标的感知;激光雷达是通过向目标发射激光束,然后将接收到的从目标反射回来的回波信号与发射信号进行比较,作适当处理后,就可获得目标的有关信息,如目标距离、方位、高度、速度、姿态、甚至形状等参数,从而对目标进行探测、跟踪和识别,激光雷达纵向测试角度±15°,角分辨率(垂直):2°,横向测试角度360°,角分辨率(水平/方位角):0.09°(5Hz)至0.36°(20Hz),转速可以设置300/600/1200(5/10/20Hz),测试范围20cm-150m,UDP模式输出。工作电压:12-24V/小于0.7A,最da功耗16W。

图3 激光雷达

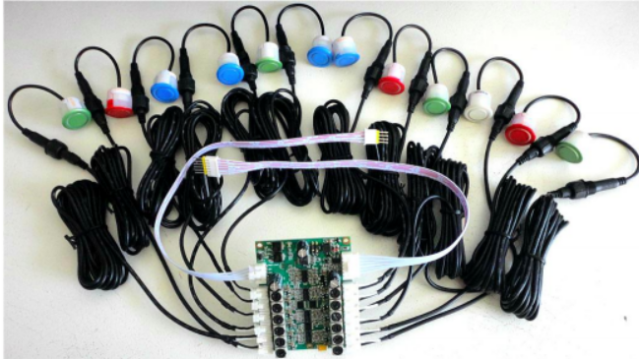

2)双目相机

本次超声波雷达设备选则的是导向电机的KS136超声波雷达,该设备为收发一体式设计,1个主控板最多可以连接12个收发一体式的超声波雷达防水探头,防水探头颜色可以根据车体定制,例如红色、黑色、蓝色、白色等。超声波雷达设备主体如图4所示。

图4 超声波雷达设备主体

KS136 单角度探头及双角度探头选择:

单角度探头(水平竖直均为 65-75°)及双角度探头(水平 120°竖直 60°)。在自动驾驶汽车或与汽车尺寸相当的大型清洁机器人、大型 AGV 机器人、履带车、起重机械等上,建议选用双角度探头,因为双角度探头水平方向波束角达到了 120°,可以有效减小不可探测区域。在机器人或AGV 车上涉及到左右判断时,建议选用单角度探头,以方便机器人进行左右判断。另外,使用双探头组合探测实现零盲区探测时,建议选择对安装没有特别要求的单角度探头。

●KS136功能

探测范围-单探头:13.8cm-450cm,探测范围-双探头:1cm-450cm。测人可到 150cm;

探测频率可达 50Hz,即每秒可探测 50 次;

支持 I2C/TTL 串口接口,兼容 KS103 协议;支持 485 接口;

共 20 个可修改的 I2C/TTL/485 地址,范围为 0xd0 ~ 0xfe (0xf0,0xf2,0xf4,0xf6 除外,

8 位地址);

5s 未收到 I2C 控制指令自动进入 uA 级休眠,并可随时被主机 I2C 控制指令唤醒;

使用工业级配置,工作温度 (-30℃~+85℃);

宽工作电压范围 (3.0V~5.5V);

I2C 模式通信速率 50~100kbit/s;TTL/485 串口通信速率默认 9600bps;用户可修改为 115200bps 等;

采用独特的可调滤波降噪技术,电源电压受干扰或噪音较大时,仍可正常工作

●KS136电气性能参数

I2C/TTL 工作电压:3.0V~5.5V;或 12V~24V 直流电源(推荐 12V)。

使用 485 接口工作电压:4.5V~5.5V;或 12V~24V 直流电源(推荐 12V)。

使用 24V 电压时请注意通风散热。

注意:已连 3.0V~5.5V 则建议 12V~24V 电源断开;已连 12V~24V 则建议 3.0V~5.5V 电源断开。

工作时瞬间最da电流:200mA@5.0V, typical。

工作电流:100mA@5.0V, typical

休眠时最da耗电量:500uA@5.0V, typical (串口模式时不休眠)

功耗:使用纳瓦技术省电,5s 未收到 I2C 控制指令自动进入 uA 级休眠,并可随时被主机 I2C 控制指令唤醒。

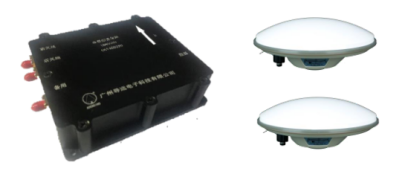

(3)定位系统

定位设备用MEMS技术的车载高精度组合惯导模块,并集成RTK卫星导航接收机,数据通过内置主控芯片的解算算法对卫星导航信息及车辆信息进行融合,可输出实时准确经纬度、高度、速度、方向等一系列载体信息,如图所示。

图5 组合导航设备

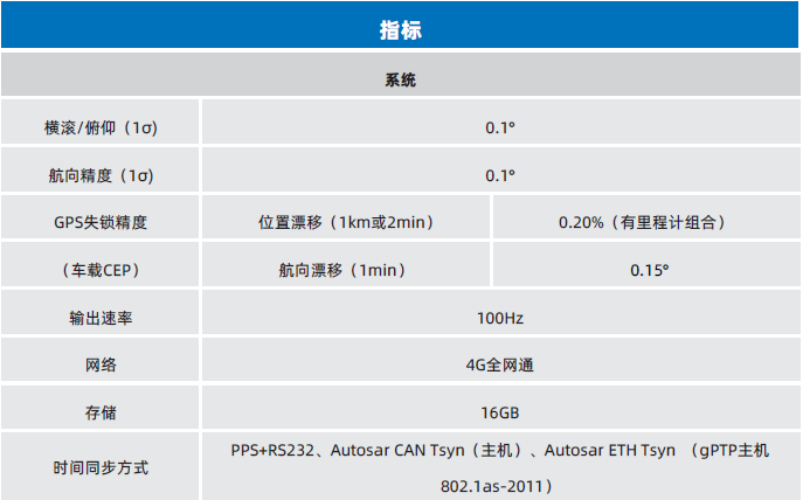

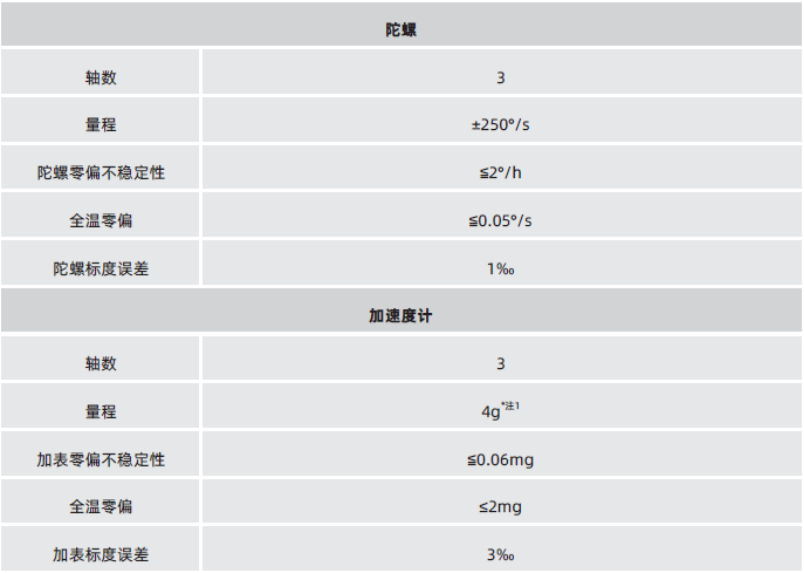

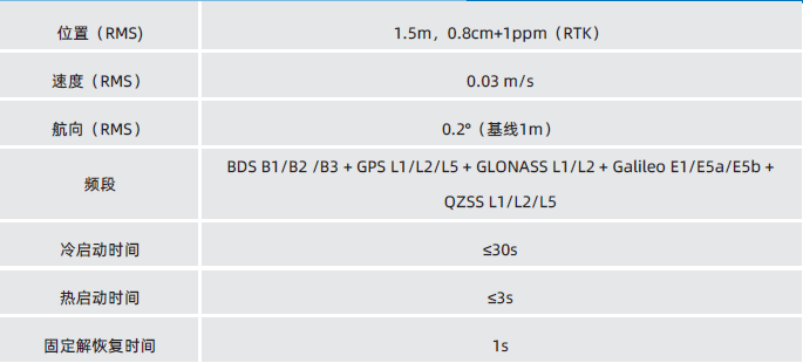

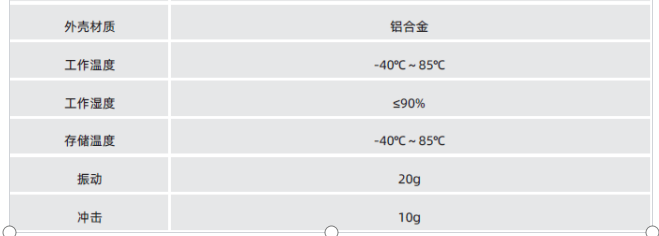

定位导航设备的参数指标如表2所示。

表3 定位设备参数

(4)其它设备

为对巡逻车进行全方位监控,集成360环视监控设备;为便于对巡逻车的设置,建立人机交互系统,需要集成PAD;为了实现车辆编队运行控制,需要集成V2X模块实现车间通信。

(5)设备汇总

设备汇总见下表。

表4 设备汇总表

序号 | 设备名称 | 参考规格/型号 | 数量 | 备注 |

1 | 16线激光雷达 | RS-LiDAR-16 | 2 | 障碍检查与融合定位 |

2 | 组合导航设备 | QYZ-221 | 1 | 含惯导单元、差分基站(移动站) |

3 | 云台摄像机 | SW-MIP7220MD-LA | 1 | 监控 |

4 | 计算平台 | C4.2 | 1 | 8路CAN、6路LAN、4路COM |

5 | 底层控制器 | D1.1 | 1 | 用于底层控制 |

6 | 车载视频终端 | SCJ-2 | 1 | 4路摄像头,SD卡录像和4G视频 |

7 | 显示屏 | HUAWEI | 1 | 人机交互 |

8 | 通信电台 | LTE-V2X/DSRC | 1 | 车间通信,数据高频传输 |

9 | 差分GPS基准站 | 1 | 场地固定或可移动基站,只需一个 | |

10 | 其它附件和材料 | 线缆、支架、声光报警等 | 1 | |

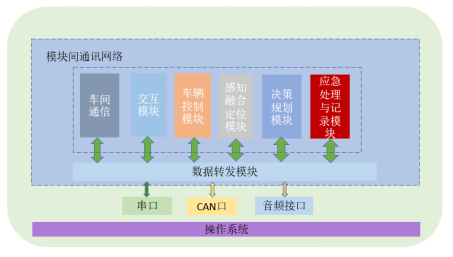

1.1.1. 车辆自动驾驶软件系统

为完成巡逻车上述场景的各项功能,自动驾驶软件需具备感知、融合、决策规划、控制、车间通信以及人机交互等模块。软件总体框架如图所示。

1.3.2.1 感知模块

(1)激光雷达感知

本方案采用基于三维激光雷达的障碍物检测与跟踪方法。首先,对三维激光雷达产生的点云数据进行预处理,先进行点云序列化,在点云序列化的基础上,利用提出的路面分割算法来分割路面点云数据,然后,对剩余的点云数据栅格化,并通过栅格增补的方法来增强一帧点云数据反映车辆靶标周边环境的能力。利用提出的8邻域栅格扩展聚类算法实现了对障碍物点云的聚类,在障碍物聚类结果的基础上,先完成了单帧中的静态障碍物检测,然后再结合定位和航向角数据实现多帧融合的静态障碍物检测,有效地提高了对静态障碍物的检测能力。在动态障碍物检测上,利用静态障碍物检测结果形成的可行驶区域和动态障碍物模板匹配算法检测出了目标动态障碍物,有效地降低了动态障碍物的误检率。在最后,利用改进的跟踪点动态切换模型和标准卡尔曼滤波器实现了对目标动态障碍物的跟踪,得到了目标动态障碍物稳定的运动状态。

1)三维点云数据预处理

激光雷达每帧产生的点云数据是在同一个参考坐标系下用以表示障碍物空间分布特征的大量点的集合,为了能有效处理如此大量的点云数据,在进行障碍物的检测和跟踪前需对障碍物点云数据进行预处理。主要包括点云序列化、路面分割、点云数据栅格化、栅格增补等过程进行预处理。

2)静态障碍物检测

本项目在障碍物检测上,采取的是先检测静态障碍物再检测动态障碍物策略,在障碍物检测前需对障碍物点云进行聚类,再利用聚类结果来检测单帧点云中的静态障碍物。由于利用静态障碍物模板匹配算法在单帧中检测静态障碍物时会存在漏检的情况,所以结合RTK-GPS数据和INS数据来进行多帧融合的静态障碍物检测,实验结果表明这样做可以有效地提高了对静态障碍物的检测能力。

3)动态障碍物检测与跟踪

在进行动态障碍物检测时,首先,采用动态障碍物模板匹配算法对可能的动态障碍物进行模板匹配检测,确定出了除已检测出来的静态障碍物以外的可能动态障碍物。同时,在多帧融合的静态障碍物检测结果的基础上利用可行驶区域搜索算法确定了车辆靶标所在车道的可行驶区域,将所有位于可行驶区域内的动态障碍物视为真正的动态障碍物,而其他可能的动态障碍物则视为普通障碍物,实现了对车辆靶标所在车道的动态障碍物检测。

4)可行驶区域检测

本项目利用多帧融合检测静态障碍物的结果,确定了对无人车路径规划和决策控制影响较大的本车道的可行驶区域,将所有位于本车道可行驶区域内已检测出来的动态障碍物视为需要被跟踪的动态障碍物,其它不在可行驶区域内的障碍物视为普通障碍物,仅将其位置信息传给无人车做路径规划和决策控制,不再进行跟踪,这样做可以很大程度上地避免误检情况的出现,同时也可以很好地满足无人车在路径规划和决策控制时对动态障碍物的感知需求。

5)动态障碍物跟踪

动态障碍物跟踪旨在获得动态障碍物的运动状态(位置、速度、航向),从而为车辆靶标的路径规划和控制决策提供更好的感知信息。首先将上一帧检测到的动态障碍物与当前帧的动态障碍物进行目标数据关联,从而确定出前后帧之间的同一动态障碍物,通过计算同一动态障碍物在两帧时间间隔里的位移来进一步计算此动态障碍物的速度和航向,最后通过将当前帧得到的动态障碍物的位置、速度和航向作为观测值代入标准卡尔曼滤波器之中,实现对各个动态障碍物的平滑稳定跟踪,得到了动态障碍物稳定的跟踪结果。

(2)双目相机感知

双目相机可形成立体视觉,是基于视差原理并利用成像设备从不同的位置获取被测物体的两幅图像,通过计算图像对应点间的位置偏差,来获取物体三维几何信息的方法。融合两只眼睛获得的图像并观察它们之间的差别,可以获得明显的深度感,建立特征间的对应关系,将同一空间物理点在不同图像中的映像点对应起来,映像点在左右两幅图像间的差别,称作视差(Disparity)。通过三角测量原理,得出视差与深度成反比例关系。

对于野外空间测量点A,在左右两张平行光轴的成像系统中分别获得成像点al,ar, 获取图像空间内的视差d = (al - ar),由三角测量的原理可知,Z = bf / d = bf / (al - ar),即可获得对于空间测量点A的精确距离感知。

1.1.1. 融合模块

由于在不同的范围内不同传感器对各个目标障碍物的检测效果不一样。随着距离的增大,各个传感器的检测效果也会随之下降,如激光雷达在目标信息采集时随着距离的增大会出现目标信息的丢失,或对目标进行单一传感器检测时会出现障碍物聚类不完整,多障碍过聚类等现象。因此提出从决策级融合的角度进行数据融合,以提高车身周围的目标检测的准确率。

为了能将多传感器的检测结果进行融合,首先需要将各个传感器检测的结果统一到相同的坐标系下。针对同一场景,不同的传感器有不同的检测条件和要求,其检测的结果也不尽相同。如激光雷达能够较好地检测距离40m以内的障碍物,对于40-60m的障碍物进行检测时,则对算法提出了较高的要求,而对于60m之外的目标,激光雷达扫描线将变得很稀疏,对检测算法要求更高,而相机或是毫米波雷达可以解决这种问题。因此,各个传感器能够分别在各自的视角下进行目标检测,对多传感器的检测结果进行融合,能够融合多个视角下的检测特征,实现更优的检测效果。

采用基于规则库融合准则的多传感器融合方法进行信息融合,如下图是建立的实现自动驾驶的融合准则库,包含对激光雷达检测的障碍物、双目相机检测的目标的融合准则,融合准则库是建立在自博弈和实际测试过程中发现问题的基础上发展起来的准则库,算法的实践性、针对性和可控性都是很强,现有队列自动驾驶的多传感器融合在基于融合准则库的融合方法下已经可以实现长时间的无人干预,同时在不断地自博弈和实际测试中发现现有融合准则库的不足,不断发展和丰富融合准则库的准则,以改进算法的普适性。将融合准则库分传感器进行融合,最后的融合结果存储在一个容器中。

1.1.2. 定位模块

定位模块的目标是获得车辆在世界坐标系下的精度位置、速度和行驶方向,为规划决策提供参考,为车辆跟踪控制提供轨迹信息。

1.1.5. 决策规划模块

车辆在行驶过程可能会遇到各种障碍、弯道等情况,自主驾驶系统需要能够根据实际的交通情况作出正确的判断使车辆能够安全运行。自主驾驶系统通过传感器融合信息获取车辆周边的交通状况,并根据这些信息进行车辆的行为决策(左转、右转、跟随等),在此基础上获取车辆的可行驶规划路径,并通过横纵向控制器实现可怜能够按照可行驶规划路径正常行驶。

(1)车辆行为决策

决策部分的智能水平决定了自主驾驶车辆靶标的整体智能水平,是自主驾驶系统中的关键技术。本项目将采用基于智能决策支持系统(IntelligenceDecisionSupportingSystem,IDSS)的自主驾驶车辆的行为决策方法,建立四库智能决策系统(模型库、数据库、方法库与知识库),如下图所示。通过大量的智能驾驶场景丰富知识库,通过知识库推理系统、问题处理系统和智能人机接口等完成自主驾驶车辆的行为决策和输出。

(2)路径规划

在自主驾驶车辆靶标的行进过程中,需要实时对车辆的运行轨迹进行规划,即局部路径规划,相比于全局路径规划,局部路径规划的特点是环境信息的不确定。其规划方法主要有人工势场法、模糊逻辑算法、遗传算法、人工神经网络、模拟退火算法、蚁群优化算法等。可以讲,在移动机器人的局部路径规划领域方面的研究是比较成熟的,但这种规划以提高智能车的避障能力为主,而效果其次。在正常直线路径行驶时,局部路径规划就是传感器感知范围内的一条直线或者近似直线,而当自主驾驶车辆遇到障碍时,则必须自主规划出绕行路径、转弯路径和换道路径等,以便继续行进。本项目采用基于变尺度栅格的启发式路径搜索算法、基于行驶状态不满意度的换道决策算法、基于X-Sin轨迹优化算法实现自动驾驶车辆的路径规划。

1.1.1. 控制模块

根据决策规划模块输出的行驶路径,按照横纵向控制策略,输出控制车辆动作,进行动态自主避障。

1.1.2. 车间通信模块

功能模块化设计方案

1)数据传输模块

首先,整个数据交互通过UDP进行PAD与V2V通信设备之间信息发送及接收。

(c)车辆管理模块

领航车和跟随车在进入pad主页前进行角色判定。接收

端程序出现异常,会利用腾讯bugly系统,记载下pad端程序崩溃日志,便于程序员程序调试和故障定位。

1.1.3. 人机交互模块

人机交互主要解决自动驾驶系统与用户之间的协同问题。主要思路如下:

1)在正常情况下,自动驾驶系统不需要人工干预或参与,它能够独立地完成所有的驾驶操作。

2)当出现自动驾驶不能应付的情况下,系统将通过声音提示,要求用户接管车辆驾驶权。

3)用户具有最高权限,可以决定随时退出自动驾驶姿态。

(2)HMI设计

本方案提供用于人机交互显示的各种信息接口协议,方便厂家能够按照自己的风格进行相关的设计。

作为前期实验演示产品,本方案会提供相关功能演示版本的HMI界面。该界面主要包含车辆信息显示部分、自动驾驶控制部分(开启、关闭、超车等)、自动驾驶系统状态显示部分、自动驾驶系统硬件状态显示部分、地图显示部分(非高精度地图)等。

1.1.4. 自主驾驶性能

1.寻迹精度:20km/h直线寻迹精度:±30cm;5km/h弯道寻迹精度:±50cm;

2.感知半径:≥10m;

3.最xiao可感知障碍物:20cm×20cm×20cm(前后10m感知范围内);

4.跟车行驶最da速度:30km/h;

5.决策时间:≤500ms;

6.响应延迟:≤1s